Erfahrungsbericht zum Benchathon zur Vermessung der Legal‑KI

Am 14. und 15. März 2026 fand der „Benchathon zur Vermessung der Legal‑KI“ statt, ein neues Format, mit dem im Rahmen der BenGER‑Studie untersucht wird, wie gut Sprachmodelle im juristischen Kontext im Vergleich zu Jurist:innen arbeiten. Die Idee dahinter: herausfinden, wann KI die juristische Arbeit sinnvoll unterstützen kann und wo man auch künftig auf eine sorgfältige menschliche Prüfung angewiesen bleibt. Der Benchathon lief gleichzeitig in Berlin, München und online, ich selbst war beide Tage komplett remote dabei.

Konkret wurden standardisierte juristische Aufgaben in verschiedenen Varianten bearbeitet, einmal rein „von Hand“ durch Menschen, einmal mit KI‑Unterstützung. So ließ sich sehr gut beobachten, wie sich Qualität, Tempo und Zuverlässigkeit der Lösungen verändern und welche Rolle Legal‑KI in der künftigen Praxis realistisch spielen kann. Getragen wurde das Ganze von einem breiten Bündnis aus Organisationen wie dem Legal Tech Verband Deutschland, dem Liquid Legal Institute, recode.law, der LMU München, der TU München sowie Partnern aus Kanzleien, Legal‑Tech‑Unternehmen und Verlagen.

Arbeitsweise im Benchathon: Struktur, Tools und Setting

Aus Sicht der Teilnehmenden fühlt sich der Benchathon an wie eine Mischung aus Examensklausur, Moot Court und Legal‑Tech‑Labor. Man bekommt klar strukturierte Sachverhalte mit Bearbeitungshinweisen und arbeitet in einer Oberfläche, in der sich Gliederung, Notizen und Lösung gut organisieren lassen. Ich habe an beiden Tagen insgesamt rund elf Stunden an unterschiedlichen Fällen gearbeitet – mal ganz klassisch nur mit Gesetz und Kommentar, mal mit bewusst eingesetzter KI‑Unterstützung beim Strukturieren und Formulieren.

Die Aufgaben deckten ein breites Spektrum ab: von typischen Gutachtenkonstellationen aus Strafrecht AT/BT und BGB‑Zivilrecht über öffentlich‑rechtliche Probleme bis hin zu klausurtypischen Examensfragen. Besonders spannend war für mich, dieselben Sachverhalte in verschiedenen Bearbeitungsvarianten zu sehen. So wurde schnell deutlich, wo KI bei gut bekannten Standardproblemen tatsächlich hilft – und wo sie zwar sehr „sauber“ formuliert, inhaltlich aber an entscheidenden Stellen falsch liegt. Gerade dieser unmittelbare Vergleich macht den Benchathon für mich so wertvoll: Man arbeitet nicht abstrakt „mit KI“, sondern muss bei jedem Fall entscheiden, ob eine Lösung wirklich tragfähig ist.

Persönlicher Hintergrund und Lernerfahrungen

Ich studiere Jura in Deutschland, bin aber Nicht‑Muttersprachler und habe vorher mehrere Jahre in der Ukraine als Rechtsanwalt, in der Strafverfolgung und bei Ermittlungsbehörden in anspruchsvollen Straf‑ und Wirtschaftssachen gearbeitet. Für mich war der Benchathon deshalb doppelt interessant: Einerseits konnte ich testen, wie gut mein aktuelles Niveau in Gutachtenstil, Gliederung und Fallbearbeitung im Vergleich zu anderen fortgeschrittenen Teilnehmenden ist. Andererseits konnte ich sehr genau beobachten, wie KI mit denselben Anforderungen umgeht, die uns im Studium und in der Praxis täglich begegnen.

Vom Gefühl her hatte der Benchathon etwas Sportliches: klar umrissene Fälle, Zeitdruck, Fokus – und am Ende sofort Feedback. Didaktisch war das extrem ergiebig. Ich habe gemerkt, wie sehr mich die intensive Arbeit mit Legal‑KI dazu bringt, meine eigene Argumentation noch klarer aufzubauen, Problemstellen präziser zu markieren und bewusster zu prüfen, wo Fehler entstehen – bei mir selbst und bei der KI. Gerade als Nicht‑Muttersprachler war es spannend zu sehen, wie Sprachmodelle „Gutachtenstil“ nachahmen – und dann ganz bewusst zu entscheiden, welche Formulierungen ich übernehme und wo ich lieber meine eigene Sprache benutze.

Ergebnisse und Leistungsbewertung

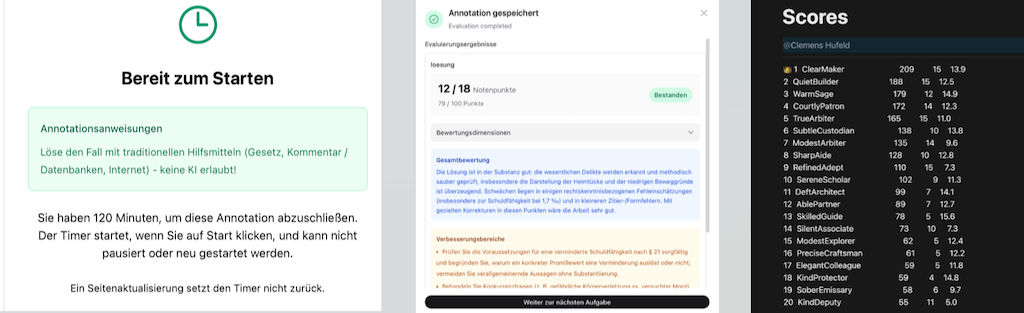

Ein persönlicher Höhepunkt waren für mich die Auswertungen am Ende. Einige meiner Lösungen wurden mit sehr guten Notenpunkten und ausführlichen Kommentaren zu Stärken und Verbesserungsmöglichkeiten bewertet – das kam einer echten Klausurbesprechung sehr nahe. In den Bestenlisten der rein menschlichen Bearbeitungen erschien ich mit meinem Pseudonym in den vorderen Rängen, was mir eine sehr konkrete Rückmeldung zu meinem aktuellen Leistungsstand im Vergleich zu anderen fortgeschrittenen Teilnehmenden gegeben hat. Rückblickend habe ich aus diesen zwei Tagen fachlich und methodisch sogar mehr mitgenommen, als ich erwartet hatte – vor allem durch den direkten Vergleich der eigenen Lösungen mit denen anderer und mit KI‑unterstützten Bearbeitungen.

Die Screenshots meiner Bewertungen, der Bestenlisten und der Gesamtübersicht zeigen sehr gut, wie fein die Ergebnisse aufbereitet wurden: Notenpunkte, qualitative Kommentare, Ranglisten für menschliche Teilnehmende und KI‑unterstützte Bearbeitungen. Diese Transparenz ist aus meiner Sicht entscheidend: Erst wenn man sehen kann, wie KI in standardisierten juristischen Aufgaben tatsächlich abschneidet, lässt sich seriös darüber sprechen, welche Aufgabenbereiche sich für einen KI‑Einsatz eignen und wo menschliche Kontrolle unverzichtbar bleibt.

Inhaltlich habe ich aus den beiden Tagen drei Dinge besonders mitgenommen:

1. Legal‑KI ist schon sehr leistungsfähig, aber noch kein Autopilot.

Bei vielen Standardproblemen sind die Vorschläge hilfreich, besonders in gut erschlossenen Rechtsgebieten. Gleichzeitig führen ungewohnte Konstellationen, knifflige Streitstände oder kleine Sachverhaltsvarianten immer wieder zu unsauberen oder falschen Ergebnissen. Im Ergebnis bleibt: KI kann viel entlasten, ersetzt aber die eigene Prüfung nicht.

2. Gutes Prompting zwingt zu klarem juristischem Denken.

Wer im Benchathon gute Ergebnisse wollte, musste die KI präzise anleiten: Sachverhalt ordnen, Normen benennen, Prüfungsaufbau vorgeben, Zwischenergebnisse hinterfragen. Im Grunde ist das nichts anderes als das, was wir im Gutachtenstil ohnehin tun – nur expliziter und strukturierter. Für mich war das ein großes Lernplus, weil ich meine innere „Gutachten‑Checkliste“ in klare Arbeitsschritte übersetzen musste.

3. Benchmarks helfen, die KI‑Debatte zu erden.

Die Grundidee des Benchathons, menschliche Bearbeitungen und Mensch+KI‑Lösungen systematisch nebeneinander zu legen, halte ich für genau den richtigen Ansatz. Statt abstrakt über „Gefahren“ oder „Chancen“ von KI zu diskutieren, bekommt man konkrete Daten: Wo ist KI schneller, wo genauer, wo klingt sie überzeugend, liegt aber falsch? Solche Ergebnisse sind eine wichtige Grundlage, um in Kanzleien, Rechtsabteilungen und Ausbildung verantwortliche Entscheidungen zu treffen.

Für das Jurastudium sehe ich in diesem Format großes Potenzial. Man lernt, KI pragmatisch einzusetzen, und wird gleichzeitig gezwungen, die eigene Arbeit kritisch zu spiegeln. Kommt die KI zu einem anderen Ergebnis als ich, muss ich entweder begründen können, warum sie falsch liegt – oder bereit sein, meine Lösung noch einmal zu überdenken. Beides ist für das Lernen enorm wertvoll.

Auch für die Praxis lässt sich viel mitnehmen. Wer heute Legal‑KI in Kanzlei oder Rechtsabteilung einsetzen möchte, braucht eine Vorstellung davon, wie zuverlässig ein Tool in typischen Anwendungssituationen arbeitet. Der Benchathon bietet dafür erste belastbare Vergleichswerte – über verschiedene Aufgabenformate und Anwendungsszenarien hinweg, unter Bedingungen, die echten Mandatskonstellationen erstaunlich nahekommen. Aus meiner Sicht ist genau das nötig, damit Legal‑KI nicht nur ein „Nice‑to‑have“, sondern ein bewusst eingesetztes Arbeitsmittel wird.

Möglich wurde der Benchathon nur durch die Zusammenarbeit vieler Akteur:innen aus Legal Tech, Wissenschaft und Praxis. Besonders hervorheben möchte ich den Legal Tech Verband Deutschland, recode.law, das Liquid Legal Institute, die LMU München, die TU München, Fieldfisher, Noxtua, Libra sowie weitere Partner aus Legal‑Tech‑Unternehmen und Verlagen, die Fälle, Infrastruktur und fachlichen Input beigesteuert haben. Für mich als Jurastudent war es beeindruckend zu sehen, wie Doktorand:innen, Praktiker:innen, Legal‑Tech‑Expert:innen und Studierende hier gemeinsam an einer datenbasierten Zukunft von Legal‑KI arbeiten.

Fazit

Nach diesen zwei Tagen bin ich vor allem eines: sehr motiviert, weiterzumachen. Der Benchathon war für mich nicht nur eine interessante Veranstaltung, sondern ein konkreter Anstoß, mein eigenes Lernen, meine Arbeitsweise und meinen Umgang mit KI‑Tools noch bewusster zu gestalten. Ich hoffe, dass das Format fortgeführt und ausgebaut wird – und dass noch viele Studierende und junge Jurist:innen die Möglichkeit bekommen, Legal‑KI unter so realistischen Bedingungen zu erleben.

Autor: Max Skydanchuk, LL.M., studiert Rechtswissenschaften an der Universität Münster. Zuvor war er mehrere Jahre in der Ukraine als Rechtsanwalt, in der Strafverfolgung und bei Ermittlungsbehörden.