Die Vollständigkeits-Illusion: Warum KI-Tools oft eloquent antworten, aber entscheidende Details übersehen

Eines der großen Missverständnisse bei KI: Sprachliche Brillanz ist nicht gleich inhaltliche Vollständigkeit. Gerade bei umfangreichen Akten leiden viele Systeme unter „Kontext-Amnesie“. Warum das passiert und wie neue Technologien das juristische Gedächtnis reparieren.

Der fleißige Referendar mit dem Tunnelblick

Stellen Sie sich vor, Sie haben einen neuen, hochmotivierten Referendar. Er liest unglaublich schnell, formuliert brillant und ist niemals müde. Sie geben ihm eine umfangreiche M&A-Akte und bitten ihn: „Fasse mir die Risiken bezüglich der Haftung zusammen.“

Der Referendar liefert sofort eine Antwort. Sie klingt perfekt formuliert, juristisch präzise, souverän. Aber bei der Detailprüfung merken Sie: Er hat nur die offensichtlichen Punkte in den Hauptverträgen gefunden. Den entscheidenden Verweis im Anhang 3, der die Haftung für Altlasten ausschließt, hat er übersehen. Nicht aus Böswilligkeit, sondern weil er den Zusammenhang zwischen dem Hauptvertrag und dem unscheinbaren Anhang technisch nicht hergestellt hat.

Genau an diesem Punkt stehen wir heute mit vielen KI-Lösungen im Rechtsmarkt. Large Language Models (LLMs) sind faszinierende Werkzeuge, aber wenn es um komplexe, über viele Dokumente verteilte Informationen geht, stoßen sie an eine unsichtbare Grenze. Um diese zu überwinden, müssen wir verstehen, wie KI eigentlich „liest“ – und warum wir ihr helfen müssen, die Punkte zu verbinden.

Das Paradoxon der großen Datenmengen

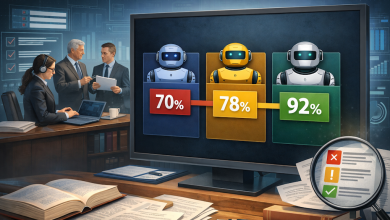

Wir leben in einer Zeit, in der KI scheinbar alles kann. Sie besteht das Examen, schreibt Gedichte und analysiert Klauseln. Doch Juristen bemerken im Alltag oft eine Diskrepanz: Bei kurzen Texten ist die KI genial. Aber werfen wir ihr hunderte Seiten an Dokumenten, E-Mails und Anlagen vor, lässt die verlässliche Präzision nach.

Das liegt nicht daran, dass die KI „vergesslich“ ist oder halluziniert. Es liegt an der Art und Weise, wie herkömmliche Systeme Informationen verarbeiten. Die größte Herausforderung für LLMs ist nicht die Sprache selbst, sondern der Kontextverlust bei großen Datenmengen. Ein Anwalt liest eine Akte und baut im Kopf ein mentales Modell des Falls auf. Ein LLM sieht oft nur eine sehr lange Aneinanderreihung von Wörtern.

Warum die KI nicht immer alles findet

Um zu verstehen, warum manchmal wichtige Details fehlen, müssen wir einen Blick darauf werfen, wie die meisten aktuellen Tools arbeiten.

Wenn Sie einer KI eine Frage zu Ihren Dokumenten stellen, liest sie meistens nicht alles Wort für Wort durch (das wäre bei tausenden Seiten zu langsam und zu teuer). Stattdessen nutzt sie eine Art „Suchscheinwerfer“.

1. Die Suche: Das System sucht in Ihren Dokumenten nach Textstellen, die Ihrer Frage ähneln.

2. Die Auswahl: Es nimmt die fünf bis zehn passendsten Textstellen heraus.

3. Die Antwort: Es sendet nur diese wenigen Ausschnitte an das Sprachmodell, um daraus eine Antwort zu formulieren.

Das funktioniert hervorragend für Zusammenfassungen oder einfache Fragen. Aber im Recht liegt der Teufel oft im Detail – und oft an ganz anderer Stelle.

Das Problem der fehlenden Verbindung: Stellen Sie sich vor, auf Seite 10 steht: „Es gelten die Bedingungen aus Anlage B.“ Auf Seite 50 (Anlage B) steht dann die eigentliche Klausel.

Wenn Sie nun nach der Klausel fragen, findet der Suchscheinwerfer vielleicht Seite 50, aber er weiß nicht zwingend, dass diese rechtlich zu Seite 10 gehört. Oder er findet Seite 10, kennt aber den Inhalt von Seite 50 nicht, weil dort Ihre Suchbegriffe nicht vorkamen.

Das Ergebnis: Die KI antwortet auf Basis unvollständiger Informationen. Sie ist schlichtweg „kurzsichtig“ in Bezug auf die Zusammenhänge zwischen den Dokumenten. Für juristische Arbeit, die auf Vollständigkeit angewiesen ist, ist das eine massive Herausforderung.

Die Lösung: Daten müssen verknüpft werden, nicht nur durchsucht

Hier kommt der entscheidende Gedanke für die nächste Generation von Legal Tech: Wir dürfen KI nicht einfach nur „auf die Daten werfen“. Wir müssen die Daten so aufbereiten, dass die KI sie wie ein Jurist verstehen kann.

Das Zauberwort heißt Struktur. Anwälte wissen, dass Dokumente nicht isoliert existieren. Ein Vertrag gehört zu einem Mandanten, eine E-Mail bezieht sich auf ein Projekt, ein Nachtrag ändert eine spezifische Klausel. Wenn wir wollen, dass die KI verlässliche Antworten gibt, müssen wir ihr diese Logik beibringen.

Neue Ansätze: Das Navigationssystem für Ihre Akten

Genau hier setzen verschiedene moderne Ansätze an, um das Problem zu lösen. Das Startup Claid Legal verfolgt beispielsweise den Ansatz des Fusion Graph.

Statt Text nur als lose Wortansammlung zu behandeln, baut ein solcher Ansatz beim Einlesen der Dokumente eine strukturierte Wissenslandkarte auf. Diese funktioniert wie ein Navigationssystem, das alle relevanten Informationen und ihre Beziehungen zueinander abbildet.

Was macht solche Ansätze anders? Sie erkennen eigenständig die Akteure und deren Beziehungen, noch bevor Sie die erste Frage stellen:

- Sie erkennen nicht nur den Namen „Müller GmbH“, sondern versteht: Das ist der Käufer.

- Sie erkennen nicht nur ein Datum, sondern verstehen: Das ist das Vertragsende.

- Sie verknüpfen Dokumente logisch und ziehen eine direkte Verbindungslinie vom Hauptvertrag zum Nachtrag und zur E-Mail-Korrespondenz.

Wenn Sie nun eine Frage stellen, muss die KI nicht mehr im Dunkeln tasten oder hoffen, dass sie zufällig die richtigen Stichworte findet. Sie „wandert“ entlang der Verbindungen im Fusion Graph.

Der Vorteil für die tägliche Arbeit: Wenn Sie fragen: „Welche Kündigungsrechte hat der Käufer?“, folgt das System den Verknüpfungen. Es springt vom Begriff „Käufer“ zum Vertrag, vom Vertrag zum Nachtrag und findet dort die Antwort – selbst wenn im Nachtrag das Wort „Käufer“ gar nicht mehr erwähnt wird, sondern nur noch von „der Partei“ die Rede ist.

Der Fusion Graph ersetzt die simple Volltextsuche durch echtes Wissensmanagement. Die KI versteht den Kontext, weil die Zusammenhänge explizit werden.

Fazit: Vom Suchen zum Finden

KI im Rechtsmarkt entwickelt sich rasant weiter. Die erste Welle brachte uns Chatbots, die gut schreiben konnten. Die jetzige Welle bringt uns Systeme, die wirklich verstehen, was in den Akten steht.

Für Kanzleien und Rechtsabteilungen bedeutet das: Es reicht nicht mehr, dass ein Tool „KI“ im Namen trägt. Entscheidend ist, was unter der Oberfläche passiert. Ansätze wie der Fusion Graph zeigen, dass wir die Kinderkrankheiten der Kontext-Verluste heilen können – nicht durch noch größere Sprachmodelle, sondern durch eine intelligentere Strukturierung unserer Daten.

Damit wird KI von einem nützlichen Spielzeug zu einem verlässlichen Partner, der auch das Kleingedruckte auf Seite 412 nicht nur liest, sondern richtig einordnet.

Autor: Julius Hirschberger ist Co-Founder von Claid Legal und Wissenschaftlicher Mitarbeiter der Universität Oldenburg im Bereich Legal Tech & AI Operations, Training & Finetuning of domain specific AI models.